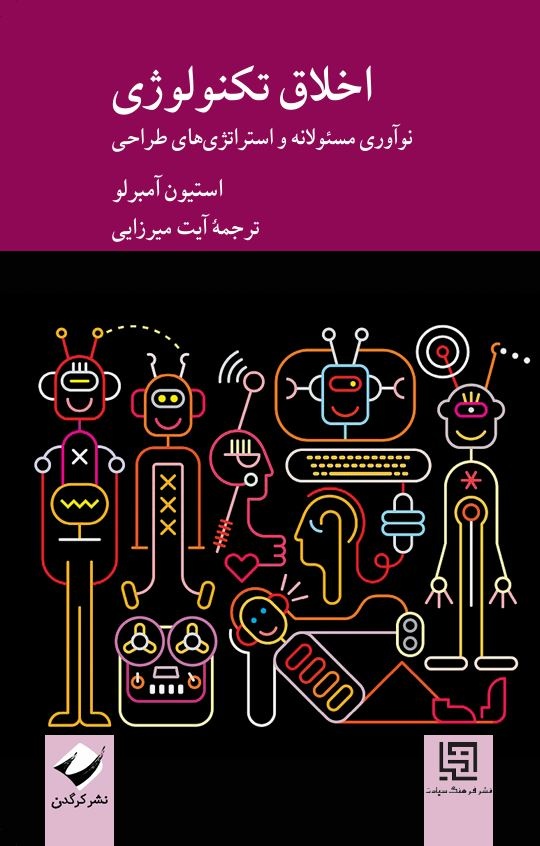

سرویس دین و اندیشه خبرگزاری کتاب ایران (ایبنا) - مسعود تقیآبادی: کتاب «اخلاق تکنولوژی؛ نوآوری مسئولانه و استراتژیهای طراحی» نوشته استیون آمبرلو، با ترجمه سیدآیتالله میرزایی (نشر کرگدن، ۱۴۰۴)، در زمانهای منتشر شده است که هوش مصنوعی، زیرساختهای دیجیتال و سامانههای پیچیده فنی از نقش ابزارهای خاموش فراتر رفتهاند و به شریک نامرئی تصمیمهای فردی و جمعی تبدیل شدهاند. این کتاب پرسشی سرراست اما برهمزننده آرامش روزمره را طرح میکند: وقتی شبکهای از ماشینها، نرمافزارها و زیرساختها درباره جان انسانها، شکل شهرها و وضعیت محیطزیست تصمیم میگیرند، مسئولیت خطا، مرگ، تبعیض و فرسایش منابع دقیقاً بر عهده چه کسی است؟ آمبرلو میکوشد اخلاق را از حاشیه توصیههای کلی و سخنرانیهای پرطمطراق بیرون بکشد و آن را وارد کارگاه طراحی، اتاق مهندسان، نشستهای استراتژی و متن حکمرانی تکنولوژی کند؛ جایی که در سکوت اسناد فنی، برای زندگی واقعی مردم تصمیم گرفته میشود.

نقطه عزیمت کتاب، واقعیت سادهای است که معمولاً پشت آمار و نمودارها پنهان میماند: تکنولوژی هرگز تنها «وسیله» نبوده است. خودرو، سد، الگوریتم، شبکه اجتماعی یا سامانه هوش مصنوعی، فقط ابزارهایی در دست کاربران نیستند؛ هرکدام با منطق درونی خود، با تنظیمات پیشفرض، با مسیرهای استفاده آسان و دشوار، و با شبکهای از منافع اقتصادی و سیاسی همراهاند که به آنها جهت میدهند. وقتی در یک شهر، شکل خیابانها و نوع خودروهای تولیدی، سالانه هزاران کشته روی جاده میگذارد؛ وقتی نوع طراحی یک سامانه بانکی، برخی گروههای اجتماعی را بهطور سیستماتیک از تسهیلات محروم میکند؛ یا وقتی الگوریتمهای پیشنهاد محتوا، یک جامعه را به سوی انواع خاصی از اطلاعات و هیجانات سوق میدهند، دیگر نمیتوان با خیال راحت گفت «خود تکنولوژی بیطرف است، تقصیر استفادهکننده است». آمبرلو دقیقاً همین نقطه کور را نشانه میگیرد و نشان میدهد که اخلاق تکنولوژی، نه در حاشیه، بلکه در قلب تصمیمهای ظاهراً فنی جای دارد.

در فصلهای آغازین، نویسنده از مشاجرهای قدیمی در فلسفه تکنولوژی آغاز میکند: اینکه اصلاً «تکنولوژی چیست؟» و در این میان، جایگاه اخلاق کجاست. او سه روایت شاخص را مرور میکند. روایت نخست، نگاه ابزارگرایانه است که تکنولوژی را وسیلهای خنثی برای رسیدن به اهداف انسانی میداند؛ در این چارچوب، اگر پیامدی فاجعهبار رقم بخورد، انگشت اتهام تنها به سمت نیتها و انتخابهای انسانها میرود، نه خود فناوری. روایت دوم، جبرگرایی تکنولوژیک است؛ دیدگاهی که در آن فناوری همچون نیرویی خودمختار، جهت کلی فرهنگ و سیاست و اقتصاد را تعیین میکند و انسان را به عنصر فرعی در داستان بدل میسازد. روایت سوم، برساخت اجتماعی تکنولوژی است که بر نقش منازعات، علایق و سازوکارهای اجتماعی در شکلگیری و تثبیت فناوری تأکید میکند و میگوید معنای هر ابزار، در میدان کشاکش نیروهای اجتماعی ساخته میشود.

آمبرلو این سه قرائت را بدون ملاحظه نقد میکند. از نظر او، نگاه ابزارگرایانه، مناسبات قدرت و نقش طراحی را نادیده میگیرد؛ گویی شکل فرمان خودرو، ارتفاع پل عابر یا نحوه تنظیم یک اپلیکیشن هیچ جهتگیری ارزشی ندارد و فقط «امکان» استفاده خوب یا بد را فراهم میکند. جبرگرایی نیز، در نقطه مقابل، انسانها را از مسئولیت میرهاند و همهچیز را به گردن نیرویی به نام «تکنولوژی» میاندازد که گویا خودش تصمیم میگیرد. رویکرد برساخت اجتماعی، با همه دقتش در نشاندادن نقش گروهها و منافع، گاهی از اثرات مادی و سخت فناوری غافل میماند؛ اینکه وقتی زیرساختی ساخته شد، تا سالها مسیر انتخابها را محدود یا تسهیل میکند. آمبرلو در نهایت موضعی تعاملی اتخاذ میکند: تکنولوژی را باید هم محصول تصمیمها و ارزشهای انسانی دانست و هم عاملی که در آینده، همین تصمیمها و ارزشها را شکل میدهد. این موضع به او اجازه میدهد تا اخلاق را نه در مقام قاضی بیرونی، بلکه بهمثابه جزئی از خود فرایند طراحی و توسعه وارد بحث کند.

طراحی حساس به ارزشها

از دل این بحث نظری، کتاب بهتدریج وارد قلمرویی میشود که برای مهندسان، طراحان و مدیران پروژههای تکنولوژیک آشناست: کجا و چگونه میتوان ارزشها را به زبان مشخصات فنی و معماری سیستم ترجمه کرد؟ آمبرلو بهصراحت میگوید نیت خوب، بیآنکه در طراحی به چیزی مشخص تبدیل شود، بیشتر شبیه حسننیت مبهم است تا عاملی موثر بر نتیجه. وقتی سامانهای برای مدیریت ترافیک شهری، بیمارستان هوشمند، پلتفرم مالی یا ابزار هوش مصنوعی طراحی میشود، دهها تصمیم کوچک و بزرگ گرفته میشود: دادهها از کجا تأمین شوند؟ چه پارامترهایی مبنا قرار گیرند؟ کدام کارها برای کاربر آسانتر و کدام پرهزینهتر شود؟ چه چیزهایی شفاف بماند و چه چیزهایی در پسزمینه پنهان شود؟ آمبرلو یادآوری میکند که هر یک از این تصمیمها، حامل جهتگیری اخلاقی است، حتی اگر طراحان هرگز این واژه را بر زبان نیاورند.

در اینجا، مفهوم «طراحی حساس به ارزشها» وارد مرکز بحث میشود. در این رویکرد، ارزشهایی مانند عدالت، حریم خصوصی، ایمنی، اعتماد، خودمختاری کاربر یا پایداری محیطزیست، نهفقط در بیانیههای سازمانی، بلکه در خود ساختار سیستم تعبیه میشود. بهجای آنکه بعد از وقوع یک مشکل، کمیتههای اخلاقی بهدنبال چاره باشند، ارزشها از ابتدا مبنای تعریف مسئله قرار میگیرند. این بهمعنای آن است که سازندگان، ذینفعان را نه در پایان کار، بلکه از آغاز فرایند وارد گفتوگو کنند: گروههایی که معمولاً در حاشیهاند، کسانی که بیشترین اثر را از فناوری خواهند دید، و حتی نسلهایی که هنوز به دنیا نیامدهاند اما زیرساختهای امروز بر آیندهشان سایه میاندازد.

آمبرلو برای اینکه بحث در حد شعار باقی نماند، از «جعبهابزار اخلاقی» سخن میگوید؛ مجموعهای از روشها و ابزارهای عملی برای سنجش، صورتبندی و پیادهسازی ارزشها. تحلیل سناریوهای بدبینانه و خوشبینانه، مشورت ساختارمند با ذینفعان، آزمایشهای میدانی با گروههای متنوع، ارزیابی تأثیر اخلاقی در کنار ارزیابی اقتصادی و فنی، استفاده از شاخصهایی برای سنجش عدالت یا شفافیت، و طراحی چرخههای بازخورد که امکان گزارش، اعتراض و اصلاح را فراهم کند، همگی در این جعبهابزار جای میگیرند. نویسنده تأکید میکند که اخلاق اگر قرار است در برابر منطق سرعت، کارایی و سود اقتصادی دوام بیاورد، باید به جزئی از روال معمول کار تبدیل شود؛ همانگونه که آزمون فشار برای یک قطعه صنعتی بدیهی شمرده میشود، آزمون پیامدهای اخلاقی نیز باید امری عادی و تکرارشونده باشد.

نکته دیگر در این بخش، نقد تصور «فناوری بیعیب» است. آمبرلو بهجای وعده سامانههایی که هرگز خطا نمیکنند، بر این ایده پافشاری میکند که فناوریهای اخلاقیتر، آنهایی هستند که امکان خطا، کشف خطا و اصلاح ساختار را به رسمیت میشناسند. سامانهای که هیچ مسیر رسمی برای اعتراض کاربران، افشاگران داخلی یا نهادهای مستقل نظارتی باقی نمیگذارد، هرچند در ظاهر بینقص و صیقلی باشد، از دید او از اساس مسئلهدار است. در مقابل، سیستمی که امکان بازبینی تصمیمها، ثبت ردپا، شفافکردن معیارها و بهروزرسانی منظم را فراهم میکند، گرچه ممکن است در کوتاهمدت کندتر یا پرهزینهتر بهنظر برسد، در درازمدت ظرفیت اخلاقی بیشتری دارد. اینجا است که «پیشرفت» جای «کمال» را میگیرد: اخلاق تکنولوژی، نه در شعار بینقصی، بلکه در توانایی اصلاح مداوم و پذیرش مسئولیت خود را نشان میدهد.

وقتی مسئولیت تکهتکه میشود

فصلهای بعدی کتاب به جایی میرسد که بسیاری از بحثهای امروز درباره هوش مصنوعی و زیرساختهای دیجیتال در آن گره خورده است: مسئله عاملیت و مسئولیت در عصر سیستمهای پیچیده. آمبرلو توضیح میدهد که در گذشته، دستکم بهصورت ظاهری، میشد برای هر حادثه تکنیکی، عامل یا عاملی را نشان داد: مهندسی که طرح را اشتباه زده، کارخانهای که در مواد اولیه صرفهجویی کرده، مدیری که هشدارها را نادیده گرفته است. اما در سامانههای امروزی، خطا معمولاً در نقطهای پدیدار میشود که هیچ فرد مشخصی در آن لحظه تصمیمی نگرفته است. الگوریتم پیشنهاد فیلم، بهتدریج برخی محتواها را تقویت و برخی را نامرئی میکند؛ سامانه نمرهدهی اعتباری، مسیری برای برخی وامها باز میکند و برای برخی میبندد؛ مدل پیشبینی پزشکی، تشخیص را برای گروهی دقیقتر و برای گروهی مبهمتر میکند. وقتی پیامد ناخواستهای رخ دهد، انگشت اتهام روی چه کسی قرار میگیرد؟

نویسنده این وضعیت را «چالش عاملیت» مینامد. در شبکهای از کدها، دادهها، زیرساختها، نهادهای نظارتی، شرکتهای پیمانکار و کاربران نهایی، عاملیت اخلاقی بهطور واقعی توزیع شده است. شرکت تأمینکننده داده شاید در انتخاب منابع، سوگیریهای تاریخی را وارد سیستم کرده باشد؛ تیم مهندسی، شاید در انتخاب شاخصهای بهینهسازی، ناخواسته برخی گروهها را به حاشیه رانده باشد؛ سازمان سفارشدهنده، شاید در تعریف مسئله، تنها بخشی از جامعه را مد نظر داشته باشد؛ قانونگذار، شاید سالها از فناوری عقب باشد و چارچوب حداقلی برای پاسخگویی تعریف نکرده باشد. این تکهتکهشدن عاملیت اگر به رسمیت شناخته نشود، مسئولیت نیز در هوا معلق میماند و هرکس، خطا را به گردن دیگری میاندازد.

آمبرلو در اینجا بر دو نکته پافشاری میکند. نخست اینکه توزیع عاملیت بهمعنای محو شدن مسئولیت نیست. هر حلقه از زنجیره، سطحی از دانش، قدرت و امکان مداخله دارد، و بر همین اساس، سطحی از مسئولیت متناسب با جایگاه خود. مدیران ارشد یک شرکت بزرگ فناوری، قانونگذاران یا نهادهای ناظر، بهدلیل دسترسی به منابع و قدرت تصمیمگیری، سهمی بهمراتب سنگینتر از یک کاربر عادی یا کارمند رده پایین دارند. دوم، چارچوبهای حقوقی و اخلاقی که همچنان بهدنبال یافتن «مقصر واحد» میگردند، در مواجهه با این شبکهها کارآیی خود را از دست میدهند. لازم است شیوههای جدیدی برای نسبت دادن مسئولیت، تعریف تعهدات جمعی و طراحی سازوکارهای پاسخگویی مشترک اندیشیده شود؛ شیوههایی که امکان سر باز زدن از مسئولیت را برای بازیگران قدرتمند دشوار کند.

این تحلیل، به بحث حکمرانی تکنولوژی گره میخورد. آمبرلو نشان میدهد که اگر سازوکارهای حکمرانی و تنظیمگری با ریتم توسعه فناوری هماهنگ نشوند، حتی دقیقترین تلاشها برای طراحی حساس به ارزشها نیز در عمل خنثی خواهند شد. سامانهای که بناست بهطور گسترده در مقیاس ملی یا جهانی بهکار گرفته شود، نمیتواند تنها با توافق میان یک شرکت و مشتری اصلیاش راه بیفتد؛ باید سازوکاری برای ارزیابی مستقل، انتشار حداقلی اطلاعات درباره منطق تصمیمگیری، امکان آزمونهای بیرونی و حتی توقف موقت در صورت بروز مشکل جدی وجود داشته باشد. در غیر این صورت، فناوری بهسادگی میتواند در سایه پیچیدگی فنی، از هرگونه سؤال اخلاقی بگریزد.

کتاب در اینجا بر اهمیت زبان روشن و قابل فهم تأکید میکند. اگر نحوه کار سامانهها، معیارهای تصمیمگیری و نوع دادههایی که در آنها جریان دارد، برای همه جز یک حلقه بسته از متخصصان مبهم بماند، امکان هر شکل از نظارت عمومی و گفتوگوی جدی از میان میرود. این بهمعنای سادهسازی افراطی نیست، بلکه نیاز به ترجمه فنی به زبان عمومی و ایجاد واسطههایی است که بتوانند میان جهان کد و سرور و جهان تجربه روزمره شهروندان پل بزنند. بدون این سطح از شفافیت، صحبت از اخلاق تکنولوژی بیشتر شبیه مناسک خواهد بود تا ابزار واقعی برای تغییر.

در سطرهای پایانی، آمبرلو بهجای صدور حکم قطعی درباره تکنولوژی، وضعیت پیچیدهتری را پیش چشم میگذارد. نه از پیشرفت تکنولوژیک بت میسازد و نه آن را منشأ تمام بدبختیها معرفی میکند. آنچه در کتاب بهدقت نشان داده میشود، چیزی است نزدیک به این تصویر: فناوری، شبکهای از انتخابهای انباشته است؛ انتخابهایی که در طراحی، در مهندسی، در قانونگذاری، در بودجهبندی، در اولویتگذاری و در چشمپوشیهای آگاهانه یا ناآگاهانه صورت گرفتهاند. وقتی به یک سد، یک سامانه هوش مصنوعی، یک شبکه حملونقل یا یک پلتفرم مالی نگاه میکنیم، در واقع داریم به تاریخ فشردهای از این انتخابها نگاه میکنیم؛ تاریخی که در سیمان، در کد، در پروتکل و در قراردادهای رسمی و نانوشته ثبت شده است.

از این منظر، پرسش اصلی کتاب از خواننده این نیست که «موافق» یا «مخالف» تکنولوژی است. پرسش بنیادیتر این است که در شبکه انتخابهایی که امروز در حال شکل دادن به فناوریهای آینده است، سهم ما کجاست و چه چیزهایی را بدیهی گرفتهایم. سکوت در برابر نبود شفافیت، عادیانگاری تلفات و آسیبها بهعنوان هزینه اجتنابناپذیر، یا پذیرش طراحیهایی که برخی گروهها را بهطور سیستماتیک در حاشیه قرار میدهد، خود نوعی مشارکت در روندی است که در نهایت به همان بحرانهایی میانجامد که در آمار مرگومیر، حوادث عمرانی و تنشهای زیستمحیطی میبینیم. «اخلاق تکنولوژی؛ نوآوری مسئولانه و استراتژیهای طراحی» از این زاویه، نه بیانیهای پرشعار، بلکه تلاش منسجمی است برای نشاندادن اینکه هر انتخاب فنی، دیر یا زود به مسئلهای انسانی برمیگردد؛ و هر جا که انسان حضور دارد، مسئله مسئولیت را نمیتوان با چند جمله کلی و مطمئن کنار گذاشت.

نظر شما